Artificial Intelligence (AI) telah digunakan sejak berpuluh-puluh tahun lalu. Seiring dengan perkembangan teknologi, semakin banyak hal yang bisa dilakukan oleh AI, mulai dari bermain game, menghasilkan gambar, sampai mengendalikan kendaraan.

Hal itu berarti, semakin banyak orang yang menggunakan dan terdampak oleh AI. Karena itulah, pemerintah dari sejumlah negara mulai didorong untuk membuat regulasi AI. Harapannya, peraturan yang dibuat pemerintah akan dapat melindungi konsumen dan pada saat yang sama, tetap mendorong perusahaan untuk mengembangkan teknologi AI.

AI Juga Punya Bias

Sebelum membahas tentang contoh negara dan region yang telah membahas atau membuat regulasi terkait AI, saya ingin menunjukkan masalah yang mungkin muncul ketika AI digunakan secara luas. Salah satunya, ketika AI menunjukkan bias dalam keputusan yang ia ambil.

Setiap orang punya bias. Pandangan seseorang akan sebuah topik biasanya dipengaruhi oleh pengalaman pribadi, stereotipe sosial, dan budaya tempatnya tinggal. Sebagai mesin, AI seharusnya bisa mengambil kesimpulan yang sepenuhnya netral, tanpa terpengaruh bias. Namun, faktanya tidak begitu.

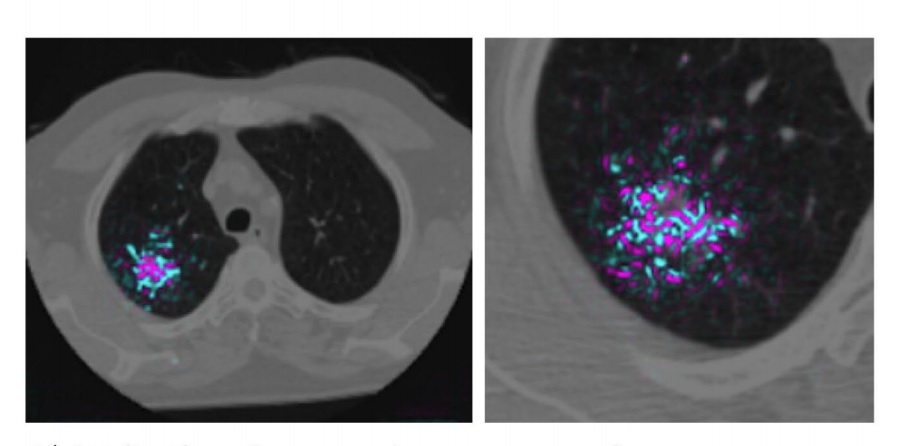

Pada 2019, studi berjudul “Dissecting racial bias in an algorithm used to manage the health of populations” membahas bagaimana tools yang digunakan untuk memprediksi risiko kesehatan di Amerika Serikat memiliki bias terhadap ras. Padahal, keputusan yang dibuat dengan bantuan tools tersebut mempengaruhi hidup dari jutaan orang di AS setiap tahunnya. Studi lain menunjukkan, software yang digunakan oleh rumah sakit besar di AS untuk menentukan pasien yang diprioritaskan mendapat transplantasi ginjal cenderung mendiskriminasi pasien berkulit hitam.

Bias pada AI muncul karena data yang digunakan untuk melatih AI juga memiliki bias. Sebagai contoh, ketika AI dilatih dengan data yang memiliki bias pada orang-orang dari Indonesia Timur, maka keputusan yang dibuat AI itu pasti akan mendiskriminasi orang-orang tersebut. Seolah hal itu tidak cukup buruk, bias yang ada pada data justru bisa terkena amplikasi oleh AI. Masalah ini pernah terjadi ketika Microsoft melakukan eksperimen dengan chatbot Tay.

Pada Maret 2016, Microsoft memperkenalkan Twitter bot, bernama Tay. Agar Tay bisa mempelajari cara manusia berkomunikasi, ia dibiarkan berinteraksi dengan pengguna Twitter. Semakin banyak orang yang “mengobrol” dengan Tay, chatbot itu akan menjadi semakin pintar.

Masalahnya, banyak orang tidak sungkan untuk menunjukkan sikap rasis dan misoginis mereka saat berinteraksi dengan Tay. Alhasil, perilaku rasis dan misoginis itu pun diserap oleh Tay. Dalam waktu kurang 24 jam setelah dirilis, Tay mulai membuat tweet pro-Nazi.

“Tay” went from “humans are super cool” to full nazi in <24 hrs and I’m not at all concerned about the future of AI pic.twitter.com/xuGi1u9S1A

— gerry (@geraldmellor) March 24, 2016

Sayangnya, menghilangkan informasi demografi, seperti ras atau gender, bukan cara yang efektif untuk memastikan AI tidak memiliki bias terhadap ras atau gender, seperti yang disebutkan oleh Harvard Business Review. Pasalnya, informasi tentang ras dan gender justru diperlukan untuk melatih AI agar bias terhadap ras atau gender bisa diketahui dan diatasi.

Hal-Hal yang Harus Diperhatikan oleh Perusahaan

Ketika AI membuat keputusan yang bermasalah — bersifat rasis atau misoginis, misalnya — tentunya hal ini juga akan akan menjadi masalah bagi perusahaan yang menggunakan AI tersebut. Dalam kasus itu, biasanya, regulator akan menggunakan hukum anti-diskriminasi standar. Hanya saja, regulasi anti-diskriminasi hanya bisa ditegakkan jika ada orang atau kelompok yang bisa diminta pertanggungjawabannya.

Ketika AI menjadi pengambil keputusan, maka tanggung jawab manusia atas keputusan yang diambil justru berkurang. Meskipun begitu, perusahaan tetap bisa dituntut jika mereka menggunakan AI yang menghasilkan keputusan diskriminatif. Hukuman yang dikenakan pada perusahaan bisa berupa denda. Tidak hanya itu, reputasi perusahaan juga bisa ikut rusak.

Saat hendak mengimplementasikan AI, perusahaan sebaiknya mempertimbangkan beberapa hal. Pertama, dampak dari keputusan yang diambil oleh AI. Jika AI berfungsi untuk memberikan diagnosa penyakit, memilih pelamar kerjaan, atau tugas lain yang mempengaruhi kehidupan banyak orang, maka sebaiknya, perusahaan menghindari penggunaan AI. Sekalipun perusahaan tetap ingin menggunakan AI, keputusan yang diambil oleh AI sebaiknya tetap diawasi oleh manusia.

Hal lain yang harus diperhatikan oleh eksekutif perusahaan sebelum mereka menggunakan AI adalah karakteristik dari tugas yang dibebankan pada AI. Riset menunjukkan, tingkat kepercayaan manusia pada AI dipengaruhi oleh tugas yang dilakukan oleh AI itu sendiri.

Jika AI melakukan tugas teknis atau mekanik, seperti seperti menganalisa gambar atau mengoptimalkan jadwal, AI dianggap bisa dipercaya layaknya manusia. Sebaliknya, saat AI bertugas untuk mengambil keputusan yang didasarkan pada situasi yang rumit dan membutuhkan empati, biasanya, AI kurang dipercaya.

Contohnya, keputusan akan hukuman yang dikenakan pada narapidana. Di situasi tersebut, keputusan yang diambil oleh manusia justru akan lebih dipercaya. Hal ini menunjukkan, jika perusahaan ingin menggunakan AI, mereka harus memastikan bahwa AI itu digunakan untuk tugas yang tepat.

Hal ketiga yang harus dipertimbangkan oleh perusahaan saat hendak memanfaatkan AI adalah skala dari keputusan yang dibuat oleh sang AI. AI memang bisa digunakan untuk mendeteksi tren atau kebiasaan konsumen di satu wilayah. Sayangnya, jika AI dilatih menggunakan data di skala nasional, ada kemungkinan, keputusan yang dibuat oleh AI tidak relevan ketika digunakan di tingkat provinsi.

Sebagai contoh, AI yang dilatih untuk mengenali kebiasaan konsumen Indonesia mungkin tidak bisa memberikan jawaban yang akurat ketika ditanya tentang kebiasaan konsumen di Kalimantan.

Masalah lain yang harus dipertimbangkan, AI yang dilatih menggunakan data nasional atau bahkan regional mungkin akan punya bias pada orang-orang di provinsi tertentu. Karena itulah, biasanya, regulator akan mencoba untuk memastikan AI tidak punya bias diskriminatif pada kelompok atau kawasan kecil.

Namun, untuk menjamin AI tidak punya bias diskriminatif pada kelompok tertentu, perusahaan harus melatih AI menggunakan data yang lebih bervariasi. Mereka juga harus memastikan AI bisa memberikan kesimpulan sesuai dengan konteks wilayah. Dan semua hal ini berarti perusahaan harus mengeluarkan biaya lebih besar untuk melatih dan mengoperasikan AI.

Terakhir, perusahaan harus memikirkan regulasi AI yang ada di negara tempat mereka beroperasi. Tentu saja, perusahaan internasional bisa saja menyelaraskan keseluruhan operasi mereka berdasarkan peraturan paling ketat. Namun, jika perusahaan global melakukan hal ini, mereka justru bisa tertinggal dari perusahaan lokal, yang beroperasi sesuai dengan peraturan yang ditetapkan oleh pemerintah di negaranya beroperasi.

Cara untuk Memastikan Akuntabilitas AI

Sama seperti manusia, AI juga bisa membuat kesalahan. AI bisa saja membuat keputusan yang merugikan atau bahkan membahayakan seseorang. Ketika manusia membuat kesalahan, dia akan diinvestigasi dan diadili sesuai dengan kesalahan yang dia buat. Namun, AI tidak bisa diadili dengan proses yang sama.

Kabar baiknya, sejak beberapa tahun lalu, Uni Eropa telah mulai membuat regulasi untuk AI. Dalam General Data Protection Regulation (GDPR), mereka memasukkan hak untuk “mendapatkan penjelasan tentang bagaimana sebuah keputusan dicapai” oleh sebuah AI. Menurut Uni Eropa, AI akan bisa semakin bisa dipercaya jika kesimpulan dan keputusan yang AI buat bisa dijelaskan pada manusia.

Perusahaan harus bisa memberikan penjelasan tentang proses “berpikir” AI yang mereka gunakan saat diperlukan. Secara garis besar, ada dua jenis penjelasan yang perusahaan bisa berikan. Pertama, penjelasan tentang keputusan yang diambil oleh AI secara umum. Kedua, penjelasan akan satu keputusan yang dicapai oleh AI di situasi tertentu.

Pada dasarnya, penjelasan tentang bagaimana AI mencapai sebuah kesimpulan hanya mencakup variabel yang digunakan oleh AI dan hubungan antara variabel tersebut. Meskipun begitu, perusahaan harus memastikan bahwa penjelasan yang mereka berikan bisa dimengerti oleh masyarakat secara umum, termasuk orang-orang yang tidak punya pengetahuan mendalam tentang AI.

Masalahnya, perusahaan mungkin tidak punya informasi lengkap tentang cara kerja dari AI yang mereka gunakan. Apalagi, jika mereka menggunakan AI buatan pihak ketiga. Seolah hal itu tidak cukup buruk, perusahaan penyedia Software-as-a-Service besar, seperti Oracle atau SAP, biasanya memanfaatkan lebih dari satu komponen AI dari perusahaan yang berbeda-beda. Dan perusahaan yang menjadi klien akan memilih komponen sesuai dengan kebutuhan mereka.

Sementara itu, untuk penjelasan dari satu keputusan yang diambil oleh AI, perusahaan bisa menjelaskan hal ini dengan mengungkap perubahan variabel yang akan mengubah keputusan AI. Sebagai contoh, AI yang bertugas untuk menyetujui permohonan pinjaman menyetui pinjaman dari seseorang yang berumur 25 tahun, tapi menolak pengajuan pinjaman dari seseorang yang berumur 24 tahun. Dari sini, bisa diperkirakan bahwa umur menjadi dasar bagi AI untuk mengambil keputusan.

Namun, tidak tertutup kemungkinan, ada alasan lain yang menyebabkan AI menerima pengajuan pinjaman seseorang, tapi menolak yang lain. Bisa jadi, AI membuat keputusan berdasarkan tempat tinggal. Orang-orang yang tinggal di luar Jawa mungkin akan lebih kesulitan untuk mendapatkan pinjaman. Dalam kasus ini, AI menunjukkan bias yang diskriminatif. Dan hal ini bisa menyebabkan masalah bagi perusahaan yang menggunakan AI tersebut.

Pembuatan Hukum AI di Amerika Serikat

Hype akan AI kini telah mencapai telinga para regulator di Amerika Serikat. Kemunculan Generative AI seperti ChatGPT dari OpenAI memunculkan kekhawatiran bahwa AI akan disalahgunakan. Karena itulah, regulator di Amerika Serikat mulai mempertimbangkan cara untuk mengatur industri AI.

Senator Chris Murphy merasa, Amerika Serikat telah melakukan kesalahan besar ketika mereka memutuskan untuk mempercayai perusahaan-perusahaan media sosial untuk meregulasi industri secara mandiri. Dia berharap, regulator AS tidak akan melakukan kesalahan yang sama dengan AI, menurut laporan Washington Post.

Mengingat para regulator sudah sadar akan isu AI, para advokat konsumen dan perwakilan dari perusahaan-perusahaan teknologi besar pun berbondong-bondong datang ke Washington D.C. Harapannya, mereka akan dapat berdiskusi dengan para regulator terkait peraturan terkait AI yang akan mereka sahkan.

Beberapa perwakilan perusahaan teknologi yang datang antara lain Brad Smith, President Microsoft, Kent Walker, President of Global Affairs Google, dan para eksekutif dari OpenAI, Palantir, dan Scale AI. Banyak dari mereka mendukung Washington untuk meregulasi industri AI.

Namun, salah satu eksekutif mengungkap, regulasi antitrust yang ada berpotensi untuk membatasi kemampuan perusahaan-perusahaan AS untuk berkompetisi dengan pesaing dari Tiongkok. Pasalnya, di Tiongkok, perusahaan bisa mendapatkan data dalam jumlah banyak dengan lebih mudah.

Juru bicara Microsoft, Kate Frischmann mengungkap, Smith percaya, regulasi antitrust tidak harus diubah karena kemunculan AI. Pada saat yang sama, para eksekutif perusahaan teknologi mendorong pemerintah federal untuk meningkatkan investasi di bidang AI. Namun, para anggota kongres tidak serta-merta percaya pada opini para eksekutif perusahaan. Karena, mereka sudah mendengar akan risiko yang mungkin muncul karena keberadaan AI.

Mike Gallagher, representatif dari Wisconsin, mengatakan, kongres harus menemukan cara yang tepat untuk membuat regulasi terkait AI demi melindungi konsumen. Pada saat yang sama, regulasi yang dibuat tetap harus memberikan ruang yang cukup bagi perusahaan teknologi untuk berinovasi.

Kongres bukan satu-satunya regulator di AS yang menaruh perhatian pada perkembangan industri AI. Federal Trade Commission (FTC) dan Justice Department juga mengaku bahwa mereka tengah memperhatikan industri yang tengah berkembang tersebut.

Belum lama ini, FTC mengeluarkan peringatan, menyatakan bahwa perusahaan-perusahaan teknologi bisa terkena penalti jika mereka melebih-lebihhkan kemampuan dari produk AI mereka. Perusahaan juga bisa dihukum jika mereka tidak mengevaluasi risiko dari produk AI yang mereka buat sebelum meluncurkannya ke pasar.

Sementara itu, Jonathan Kanter dari Justice Department mengatakan, mereka telah memulai program “Project Gretzky” di Februari 2023. Fokus dari proyek ini adalah untuk memastikan mereka tahu tentang isu terbaru terkait industri AI. Sayangnya, saat ini, pergerakan regulator di AS untuk membuat hukum akan AI cenderung lebih lambat dari negara-negara lain, khususnya Uni Eropa.

Regulasi tentang AI di Uni Eropa

Uni Eropa tengah mempertimbangkan regulasi baru untuk mengatur penggunaan dan pengembangan AI. Ialah Artificial Intelligence (AI) Act, yang fokus untuk memperkuat peraturan terkait transparansi, kualitas data, pengawasan manusia, dan akuntabilitas. Selain itu, peraturan ini juga akan membahas tentang masalah implementasi AI di berbagai bidang serta dilema moral di baliknya. Apalagi, karena AI kini digunakan di berbagai bidang, mulai dari kesehatan, edukasi, sampai finansial dan energi.

AI Act sendiri diajukan oleh European Commission pada April 2021. Dan sekarang, peraturan ini sedang didiskusikan oleh European Parliament. Thierry Breton, Commissioner for Internal Market, Uni Eropa mengatakan, AI Act diharapkan akan bisa “memperkuat posisi Eropa sebagai pusat perkembangan AI”. Pada saat yang sama, regulasi baru itu juga dibuat dengan tujuan untuk memastikan penggunaan dan pengembangan AI akan tetap sesuai dengan nilai dan peraturan di Eropa.

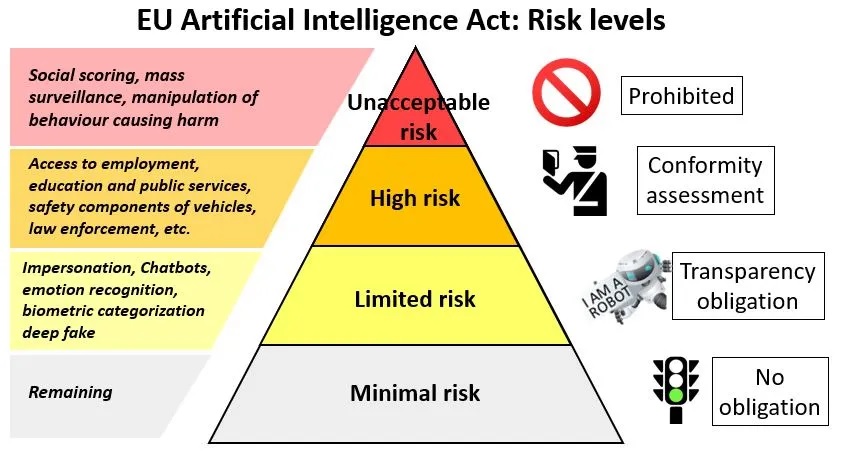

Pada dasarnya, AI Act akan membagi produk AI ke dalam empat kategori, berdasarkan risiko penggunaan AI pada hak dasar manusia, serta kesehatan dan kemanan masyarakat. Empat kategori dalam AI Act antara lain: unacceptable, high, limited dan minimal, menurut laporan World Economic Forum.

Contoh AI dengan risiko minimal adalah spam filter atau AI pada video game. Tidak banyak peraturan yang harus dipatuhi untuk menggunakan AI tipe ini. Perusahaan hanya harus mematuhi regulasi terkait transparansi data. Sementara itu, AI yang berfungsi untuk mengidentifikasi seseorang berdasarkan biometrik secara real-time masuk dalam kategori unacceptable risk. AI jenis tersebut hampir selalu dilarang untuk digunakan.

AI dengan risiko tinggi boleh digunakan oleh perusahaan. Namun, baik developer maupun pengguna AI harus mematuhi regulasi yang ditetapkan. Selain itu, mereka juga harus melalui proses pengetesan yang ketat. Mereka juga diminta untuk melakukan dokumentasi tentang kualitas data serta akuntabilitas framework yang menjelaskan tentang pengawasan manusia atas AI tersebut. Contoh dari AI yang masuk dalam kategori risiko tinggi adalah kendaraan otonom, peralatan kesehatan, dan infrastruktur penting.

Kesimpulan

Kemajuan teknologi memang selalu seperti pisau bermata dua. Di satu sisi, keberadaan AI akan memudahkan hidup manusia. Di sisi lain, jika tidak digunakan secara hati-hati, AI justru bisa membahayakan dan merugikan banyak orang. Karena itu, pemerintah punya peran penting sebagai regulator. Mereka harus bisa membuat regulasi yang cukup ketat untuk melindungi konsumen. Di saat yang sama, mereka juga sebaiknya tetap terus mendukung industri AI.

Di sisi lain, peran aktif juga dibutuhkan untuk hadir dari para pelaku ekosistem AI sendiri, termasuk perusahaan yang bergerak di bidang AI atau yang membuat tools berbasis AI. Mengedepankan etika kemanusiaan dalam mengembangkan teknologi AI akan juga memberi dampak bagi pegembangan teknologi yang tetap humanis.

Sumber header: Wikipedia