Para peneliti yang melakukan riset di Microsoft, baru saja mengumumkan sebuah model kecerdasan buatan berbasis audio yang dinamakan VALL-E. Cukup dengan menggunakan sampel audio berdurasi 3 detik saja, artificial intelligence (AI) tersebut mampu merekayasa suara seseorang. Ketika sebuah suara tertentu berhasil direkayasa, VALL-E bisa mengubah intonasi hingga nada emosi dari suara orang tersebut.

Lalu buat apakah AI ini nantinya? Penciptanya menjelaskan bahwa teknologi ini bisa digunakan di aplikasi text-to-speech, untuk menghasilkan suara berdasarkan transkrip yang telah disiapkan. Jadi, orang tersebut hanya perlu menyiapkan naskah yang berisikan apa saja yang ingin disampaikan, tanpa harus merekam suaranya secara manual. Hal ini dirasa cukup membantu untuk kegiatan seperti membuat konten.

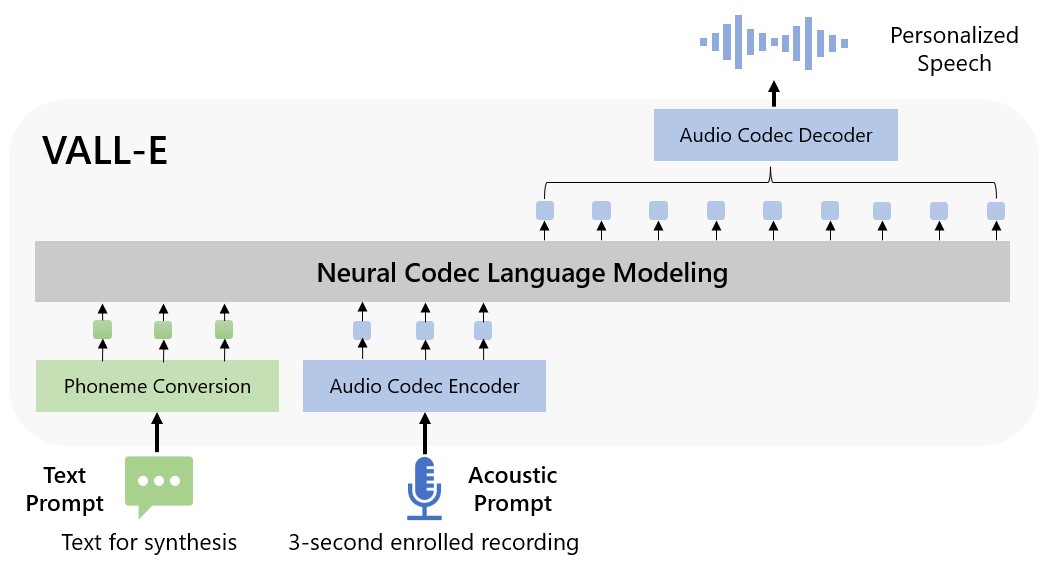

VALL-E yang dibuat menggunakan EnCodec dari Meta ini akan menganalisa bagaimana seseorang menghasilkan suara, memecah informasinya ke dalam komponen-komponen, lalu menggunakan data traininguntuk mencocokkan apa yang telah dipelajari oleh AI ini mengenai bagaimana suara yang sedang diolah ini terdengar, jika melafalkan kata-kata atau kalimat selain dari sampel suara 3 detik tadi.

Microsoft memaparkan semua proses dan cara kerja VALL-E di sini.

Microsoft melatih kemampuan VALL-E dalam sebuah lingkungan (yang dikumpulkan oleh Meta) bernama LibriLight. Perpustakaan audio tersebut memiliki 60 ribu jam pembicaraan bahasa Inggris oleh lebih dari 7 ribu penutur. Untuk bisa mendapatkan hasil yang baik, sampel suara yang dimasukkan harus mampu mendekati salah satu suara dari koleksi suara tersebut.

Walaupun potensi yang dimilikinya sangat luas, Microsoft sadar betul mengenai dampak negatif yang bisa VALL-E hasilkan. Jadi Microsoft hanya memublikasikan kemampuan dan cara kerja AI ini tanpa menyebarkan source code-nya.

“Karena VALL-E mampu merekayasa sebuah cara berbicara yang juga merupakan identitas dari pembicara tersebut, kemungkinan terjadinya dampak buruk cukup besar, contohnya penyalahgunaan seperti membobol identifikasi berbasis suara atau aksi menipu dengan meniru seseorang. Untuk mencegah hal-hal tersebut, dibutuhkan sebuah metode untuk mendeteksi sebuah klip audio yang direkayasa oleh VALL-E atau suara asli,” ungkap para peneliti Microsoft di akhir laporannya.