Pernah nonton film “Her“? Film fiksi-ilmiah yang menggambarkan kehidupan manusia di masa depan, dikisahkan dalam film tersebut, aktor utama (Joaquin Phoenix) jatuh cinta pada virtual assistant bawaan sistem operasi yang merupakan program AI.

10 tahun yang lalu ketika film tersebut dirilis, cerita ini seperti dongeng khayalan belaka, namun kini hal tersebut mulai tampak mungkin.

Melalui acara live streaming OpenAI Spring Update kemarin, OpenAI seperti mengubah film “Her” dari fiksi-ilmiah menjadi lebih mirip film dokumenter. Bagaimana tidak; kita bisa ngobrol dengan mesin seperti kita ngobrol dengan manusia, bahkan bisa meniru logat serta intonasi manusia dengan sangat luwes, sehingga mungkin bisa berdampak secara emosional. 😀

Mungkinkah OpenAI sudah berhasil membuat AGI (Artificial General Intelligence)? Atau setidaknya telah berhasil membuat model yang lulus turing test seperti yang ada pada film Ex Machina? Mari kita bahas.

Update terbaru GPT-4o

Pada acara Spring Update kemarin OpenAI mengenalkan model terbarunya yang mereka sebut dengan GPT-4o, model ini diklaim lebih cepat dari GPT-4 dan bersifat multimodal, artinya bisa menerima inputan berupa teks, gambar, audio bahkan video, menariknya lagi bisa memproses semua jenis inputan tersebut secara real-time.

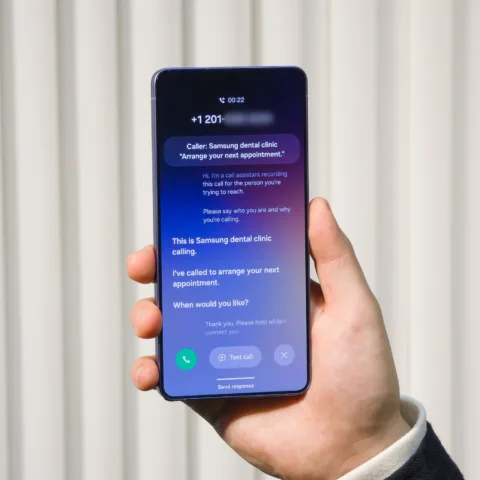

Perlu diakui ini merupakan kemajuan yang penting, mengingat sebelumnya kita hanya bisa berinteraksi secara bergantian (turn-based) yang tidaklah natural bagi manusia. Namun dari demo yang ditontonkan kemarin, kini pengguna bisa berinteraksi tanpa harus bergantian untuk berbicara, bahkan kita bisa menyela ketika AI sedang bicara. Walaupun cara AI menghentikan suaranya masih aneh, terasa kaku dan tidak natural, misalnya memutus di tengah kata secara prematur, naturalnya manusia akan menyelesaikan satu kata agar lengkap terlebih dahulu sebelum menghentikannya.

Bagaimana dengan koneksi internet?

Hal lain yang masih mengganggu pikiran saya adalah masalah koneksi internet, karena pemrosesan LLM tidak dilakukan secara lokal/offline, maka setiap input harus terlebih dahulu dikirimkan ke server (online) melalui jaringan internet untuk diproses oleh “GPU” baru kemudian output atau hasilnya dikirimkan kembali ke perangkat mobile, kondisi seperti ini tidak efektif pada koneksi internet yang labil, itu kenapa tidak heran ketika Mark Chen mengeluarkan iPhone yang tertancap kabel khusus untuk “menjaga” koneksi internet selama demo.

Tentu hal ini sangat krusial, karena secepat apapun kemampuan model memproses demi mengejar real-time akan jadi tidak real-time ketika yang bikin lama adalah koneksi internetnya.

Tak ada info GPT-5?

Hal lain yang membuat saya kecewa adalah tidak adanya bahasan tentang GPT-5, padahal saya berharap di Spring Update kemarin ada pengenalan tentang GPT-5 yang rumornya mendekati level AGI. Sayangnya, pada acara kemarin Open AI hanya mengumumkan ada pembaharuan GPT-4 “modifikasi” saja, bagi saya event tersebut hanya seperti memamerkan optimasi pada GPT-4 dan teknik real-time response saja.

Apakah ini artinya AGI masih jauh dari bayangan, atau OpenAI memang belum berhasil membuatnya?

Namun terlepas dari itu semua, menurut saya terobosan OpenAI ini akan mengubah banyak hal di kehidupan manusia secara signifikan, terutama pada cara manusia berinteraksi dengan mesin. Bisa jadi di masa depan nanti, dominasi smartphone tidak lagi kita operasikan melalui UI berbasis visual, namun UI berbasis audio.

Ingat Jarvis? Ya, AI-nya Iron Man yang bisa disuruh-suruh melakukan berbagai kerjaannya Tony Stark hanya dengan perintah suara. Kalaupun Jarvis masih punya tampilan visual itu hanya di bagian tertentu yang butuh pencitraan, seperti untuk melihat peta, foto, tabel, chart, penyesuaian hasil output generative AI, atau untuk pekerjaan minor yang butuh dalam mode senyap.

Di masa depan, bisa jadi tampilan smartphone yang kini kita kenal juga akan berubah dari yang bisa kita bayangkan saat ini. Jadi tidak menutup kemungkinan tools ala Jarvis akan ditemukan dengan mudah dawal waktu tidak lama.

Lalu apakah OpenAI dengan GPT-4o akan memantik revolusi dalam waktu dekat? Menurut saya belum, masih ada PR terutama di isu latency karena dependensi internet yang masih mandatory.

Tetapi hal ini akan bisa terselesaikan apabila model bisa jalan secara lokal/offline di perangkat mobile. Dan kalau melihat teknologi yang kita punya saat ini, hal itu masih jauh dari panggang. Kita harus menanti hingga ditemukan chip khusus AI yang bisa menggantikan GPU dan bisa disematkan pada perangkat konsumen secara murah, ketika itu terjadi saya rasa GPT-4o akan lulus “turing test” seperti yang ada di film Ex Machina.

Artikel ini ditulis oleh Robin Syihab, software engineer, system engineering consultant, former reverser & malware researcher, DVORAK, scala and Rust enthusiast.